國內外許多銀行和金融機構的客服中心現在面臨最大的問題,就是有大量使用語音複製技術的深度偽造電話試圖闖入客戶帳戶並發起詐騙交易。

我們是科技進步的受惠者,而這些攻擊者也跟我們一樣,今天構建深度偽造的工具比以往任何時候都更便宜、更容易獲得,即使是沒有任何技術知識背景的人也有機會設計出複雜、由 AI 驅動的詐騙手法。

Deepfake 的可怕之處:聲音、影像、文字都可一手偽造

Deepfake 深度偽造是一種合成媒體,包含圖像、影像、音訊或文字,不管是看起來還是聽起來都跟真實人類沒兩樣,但它實際上是用生成式 AI 模型所製作或控制的。

舉例來說,深度偽造音訊是指,使用深度學習模型創建或修改的合成或生成之聲音。深度偽造音訊的一種常見製作方法是語音複製,僅使用不到一分鐘的真人語音樣本就可以創建假的音訊,而這種技術在使用語音生物特徵驗證來存取客戶帳戶的產業中風險極大。

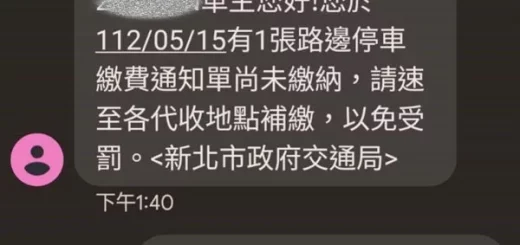

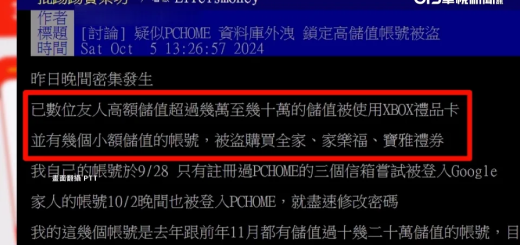

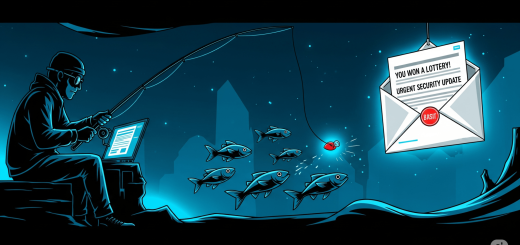

接著則是深度偽造文字,指的是在模仿人類寫作風格、結構和語調的人工生成內容。這些深度偽造模型在大型文字資料庫上進行訓練,以學習單詞之間的模式和關係,生成出看起來就是人類對話的句子,來幫助網路犯罪分子進行大規模的社交工程和網路釣魚攻擊,並且在偽造文件中同樣有用。

Deepfake 內容該怎麼破解?這家新創要用 AI 打 AI

面對這種越來越具體的威脅,規模越大的企業就越應該能夠準確、快速、大規模地偵測人工智慧生成的聲音、影片、圖像和文字等內容。

而「文字和圖像偵測器」是抵禦假文件、身份盜用和網路釣魚努力的最佳解決方案。例如,新創 Reality Defender 就是利用了 AI 技術,去對抗攻擊者製作的假內容,它的做法是從很多真實的內容中,去學習真實內容的特徵和規律。簡單來說,它會分析真人說話時的語調、咬字和換氣等習慣,也會分析真實影片和圖片中的細節和邏輯。

經過大量的學習和訓練之後,Reality Defender 就能夠建立起一套標準,知道真實內容通常長什麼樣子。 所以,當有新的內容被上傳到系統時,Reality Defender 就會用這套標準去檢查,如果發現這個新內容的特徵和真實內容有明顯的差異,看起來不太自然,那很可能就是人工智慧生成的假內容。

這種用 AI 打 AI 的厲害之處就在於,它導入了好幾種不同的人工智慧模型,從不同的角度去分析每一個檔案,此外還會隨時更新,學習攻擊者最新的造假技術,讓自己的檢查方法與時俱進。